News

2023.06.29

知財ニュース

テキストから人の動きの動画を生成するAI「MotionGPT」が公開、テンセントらが発表

テキストプロンプトから人の動きを3D動画で生成する動画自動生成技術「MotionGPT」が公開された。

人間の動作はボディランゲージの1つで、言語と似た意味合いを持つ。そうした着眼点から動きを言語の1つとして学習させた言語モデルが「MotionGPT」だ。中国・テンセントの研究者が開発し、現在、ソフトウェア開発のプラットフォームのGithubで公開中だ。

「MotionGPT」は現在、テキストプロンプトから人の動きを3D動画で生成する、動きをテキストで説明する、動きを予測するなどの機能を持つ。

昨年来、OpenAIのGTP-4をはじめとした大規模言語モデル(LLM)の開発が世界中で行われ日々進化する中で、言語とモーションを統一したモデルの構築は進んでいないという。一方で、言語とモーションを融合した汎用的なモデルが構築されれば、デジタルヒューマンやバーチャルアシスタント、ロボットなどの動きの進化が図れる。

そうした背景から「MotionGPT」が誕生。開発者らは、人間の動きと言語が結びついたモーション言語モデルとして、モーション関連タスクのパフォーマンス向上を目指している。

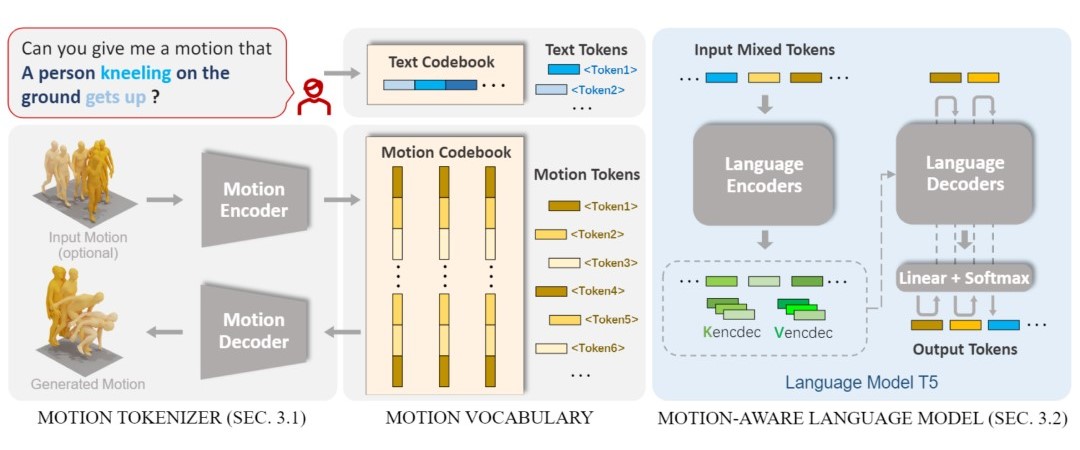

開発にあたっては、人間の動きを3Dで捉え、動きの制御を行うモーショントークンに変換して「モーション・ボキャブラリー」を構築。それをもとに動きを特定言語として扱い、テキストとモーションを統一した方法でモデル化した。さらにモーションと言語の混合データで事前に機械学習を行い精度を高めている。

MotionGPTは現在、関節を持つ人体の全身の動きと言語の融合にフォーカスしており、顔や手など部分的な動きの活用は想定していない。

人の動きを融合させた言語モデル「MotionGPT」。広く活用されれば、デジタルヒューマンやロボットとのコミュニケーションはより深まると期待される。

Top Image : © OpenMotionLab