News

2023.09.29

知財ニュース

MITの研究チーム、生成AIによる画像加工を防止するツール「PhotoGuard(フォトガード)」を発表

マサチューセッツ工科大学(MIT)のハディ・サルマン氏らの研究チームは、2023年7月に開催された「機械学習に関する国際会議(ICML)」で、フェイク画像生成防止ツール「PhotoGuard(フォトガード)」の開発を発表した。

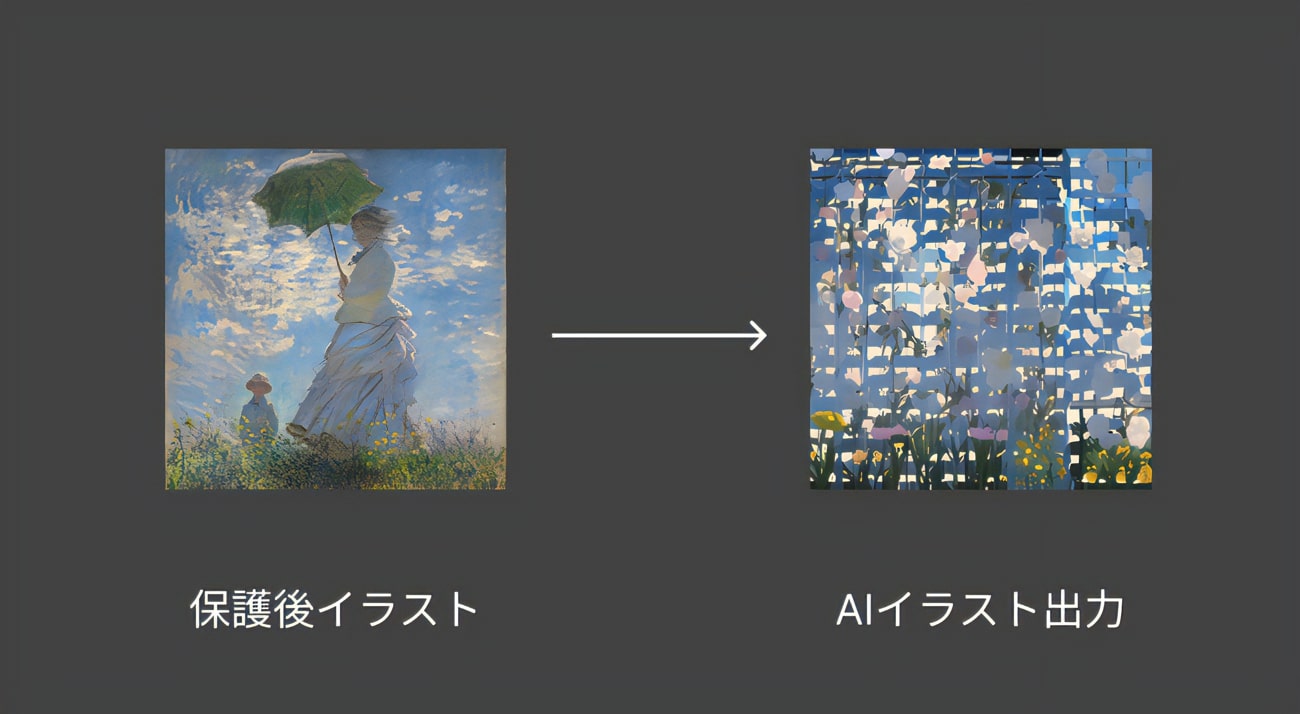

「PhotoGuard(フォトガード)」は、写真や画像に芽には見えない改変を加え、AIによる加工を防止するシステム。「PhotoGuard」を適用した画像をAIで編集すると、不自然な画像で出力される。

「PhotoGuard」は、エンコーダーによるデータ処理とノイズの画像変換処理の双方を攻撃。エンコーダーによるデータ処理に攻撃を行った場合(ディフュージョン攻撃)は、元の画像が改変され、プロンプト(命令文)の内容は画像に反映される。一方、ノイズの画像変換処理に攻撃を行った場合(エンコーダー攻撃)は、元の画像は反映され、背景がノイズだらけになる。

同チームによると、「PhotoGuard」は「免疫」をもとにヒントを得たとのこと。論文では、「PhotoGuard」は「綿密に細工されたゆらぎを画像に付加することで、AIを用いた画像操作に対する特殊な抵抗力を与える」と述べている。

近年飛躍的な進化を遂げている画像生成AI。しかし、技術の向上に伴い、被写体の認証を得ていないディープフェイク・ポルノなど、深刻な問題も生まれている。同大学の試みがAIツールによる画像改ざんを防ぐ特効薬となることに期待したい。

「イラストを無断のAI学習から保護する投稿サイト「emamori」公開─「透かし」技術でAIによる作品模倣を阻止」(ニュース記事)

Top Image : © マサチューセッツ工科大学(MIT)