News

2023.05.10

知財ニュース

Microsoft、ChatGPTのような大規模言語モデルを従来の15倍高速、低コストで学習できる「DeepSpeed-Chat」をリリース

米MicrosoftはChatGPTなどのモデルを訓練できる「DeepSpeed-Chat」をリリースした。

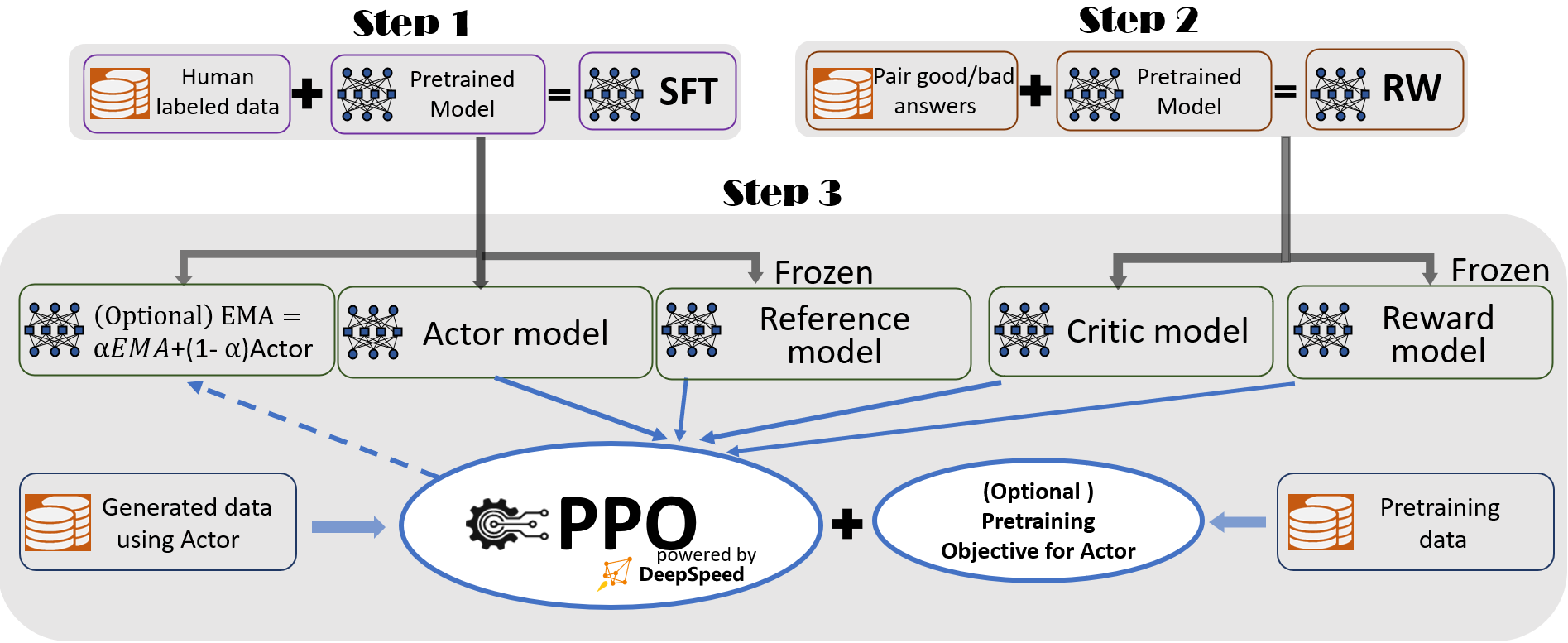

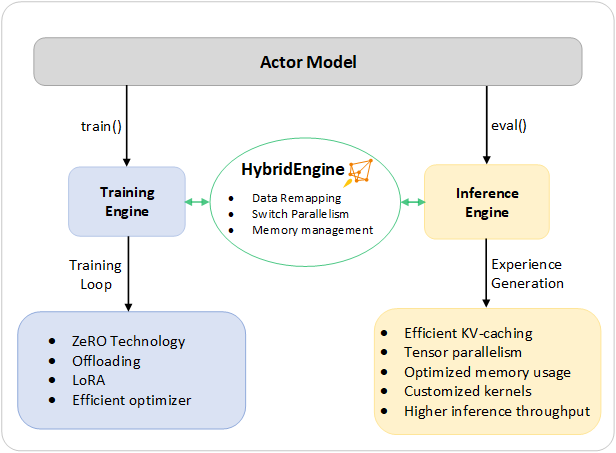

「DeepSpeed-Chat」はChatGPTでも採用されているRLHF(Reinforcement Learning from Human Feedback:強化学習)を効率的に実行するためのツール。RLHFの実行には、これまで高価なGPUを大量に使う必要があったが、DeepSpeed-Chatは少ないGPUで効率的に学習可能。GPU1台で100億以上のパラメータを学習可能にする。

また、学習スピードも既存の15倍以上で、スクリプト一つで簡単かつ低コストで実行できるのも特徴。GPU「A100-80GB x8」を使ってクラウド上で大規模言語モデル「OPT-B13」を訓練する場合、9時間程度で訓練が完了し、コストも290ドル(日本円で約39,000円)程度という。なお、複数台のGPUを使えば1000億パラメータ規模のモデルの学習にも対応できる。

大規模言語モデルは、訓練の時間や、計算機資源、品質の要件を満たすためには、さまざまなモデルのサイズや構成を試す必要があるが、「DeepSpeed-Chat」ならその工程が簡単に完了する。GPUクラスタでより大規模で高品質なモデルを訓練したい場合、希望するモデルサイズとGPU数を指定するだけで訓練が可能になる。

同社は、「DeepSpeed-Chat」をオープンソースソフトウェアとしてAIコミュニティに公開。現在サポートされている機能や、将来的にサポートされている機能については、ロードマップを参照とのこと。同社は、「コーヒータイムや昼休みに、小規模なトイモデルをトレーニングしてみては」と手軽さをアピール。今後は、ユーザーからのフィードバックや協力により、継続的に改善していくという。

Top Image : © Brilliant Labs